使用IntelliJ IDEA开发Spark Maven应用程序

虽然Spark官方推荐使用SBT来构建Spark项目,但仍然有很多人习惯使用Maven。接下来我们演示如何使用IntelliJ IDEA开发Spark Maven应用程序。

集成开发环境IntelliJ IDEA的安装,请参考上一节中的安装步骤。请确保已经安装了JDK 8和Scala插件。

本节主要内容包括:

一、创建IntelliJ Maven项目

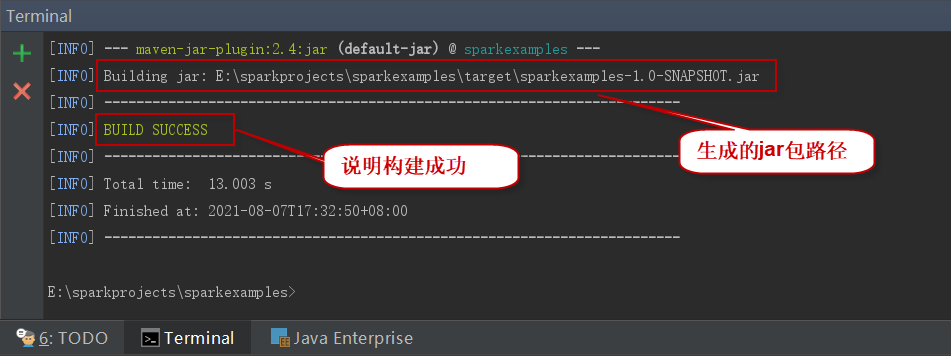

首先启动IntelliJ IDEA,依次选择File > New > Project > Maven,从模板创建Scala Maven项目。如下图所示:

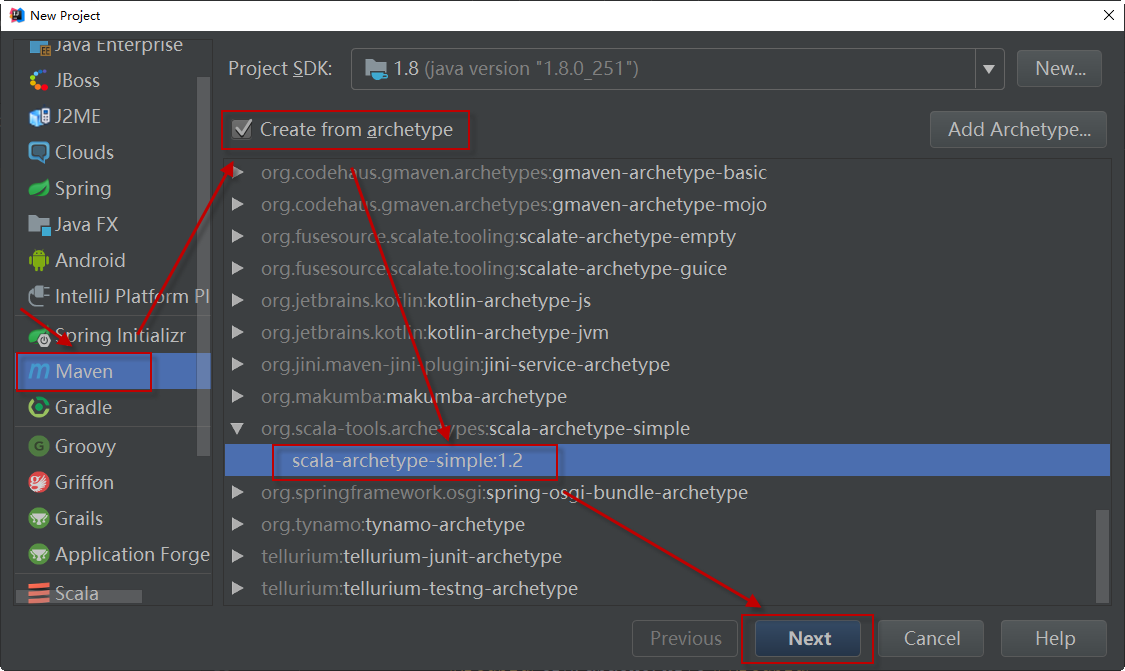

在接下来的向导窗口中,命名项目如下:

GroupId: com.xueai8 ArtifactId: sparkexamples Version: 1.0-SNAPSHOT

然后单击Next按钮继续。如下图所示:

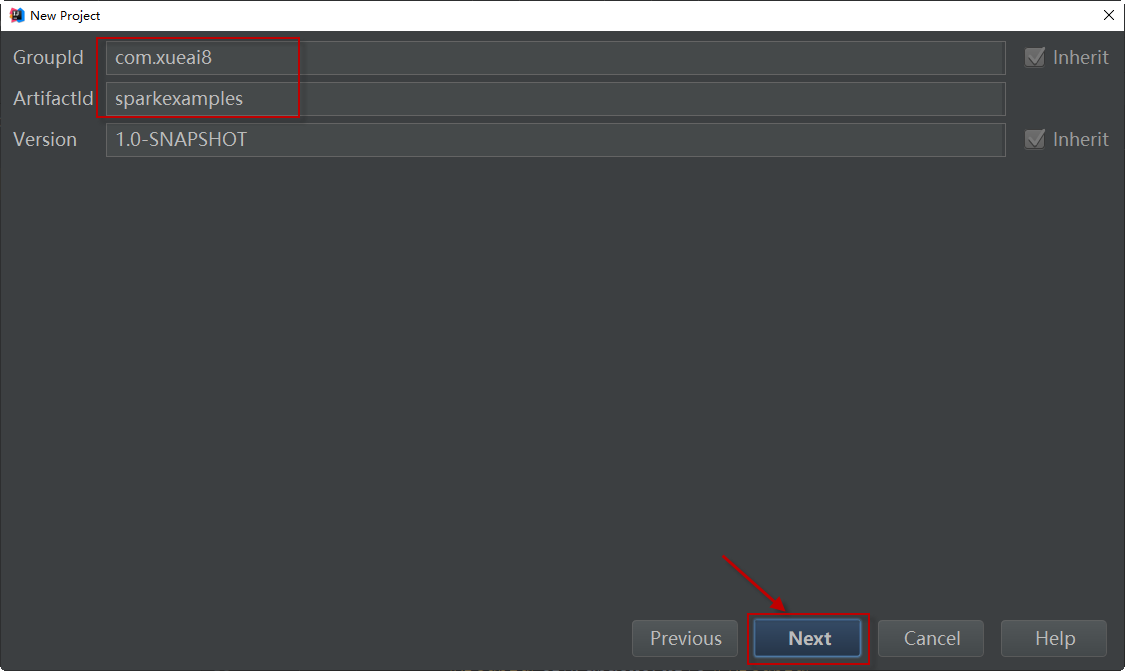

接下来,设置Maven的settings文件和repository位置。选择默认就好了。

最后,选择项目名称和位置。这些字段应该自动填充,所以使用默认值就好了。然后按下【Finish】键,开始生成项目。

IntelliJ应该创建一个具有默认目录结构的新项目。生成所有文件夹可能需要一到两分钟。

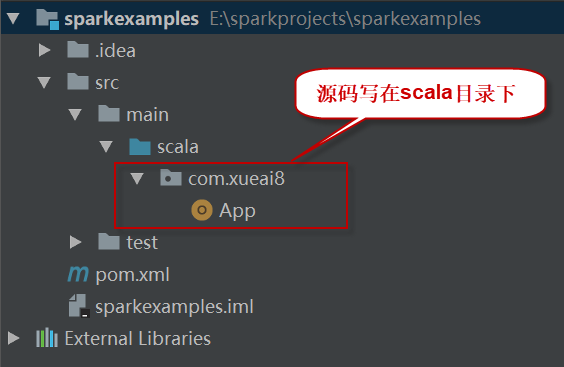

让我们了解一下项目结构:

- .idea:这些是IntelliJ配置文件。

- src/main/scala:源代码。源代码应该位于此目录下。而test文件夹应该保留用于测试脚本。

- target:当对项目编译时会产生此目录。

- pom.xml:Maven配置文件。使用这个文件导入第三方库和文档。

二、验证SDK安装和配置

在继续之前,让我们先验证几个IntelliJ设置:

1) 验证导入Maven项目是否自动打开。

【File】 > 【Settings...】 > 【Build, Execution, Deployment】 > 【Build Tools】 > 【Maven】 > 【Importing】

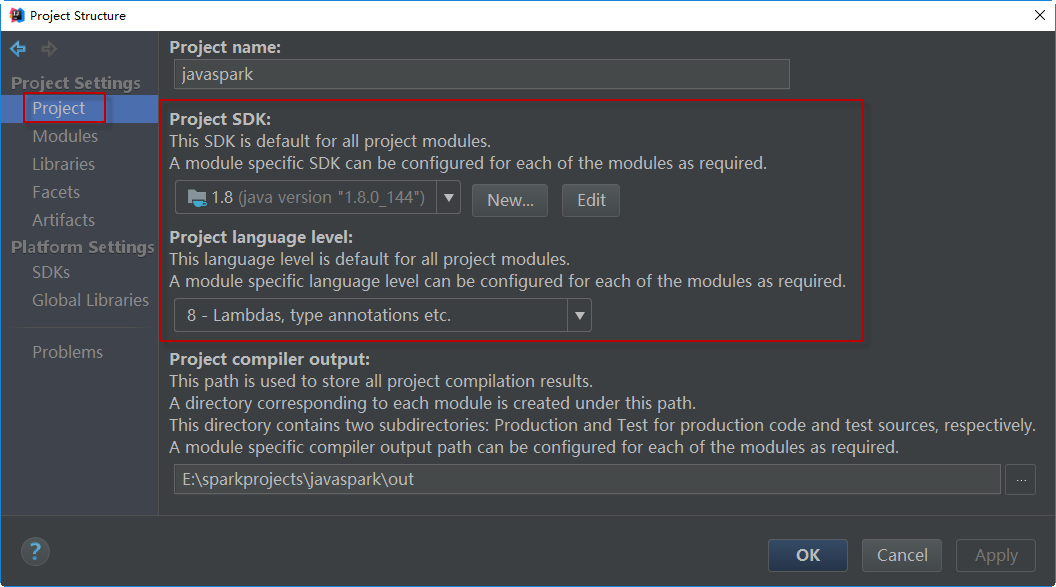

2)验证项目的Project SDK和Project language level设置为Java版本:

【File】 > 【Project Structure...】 > 【Project】

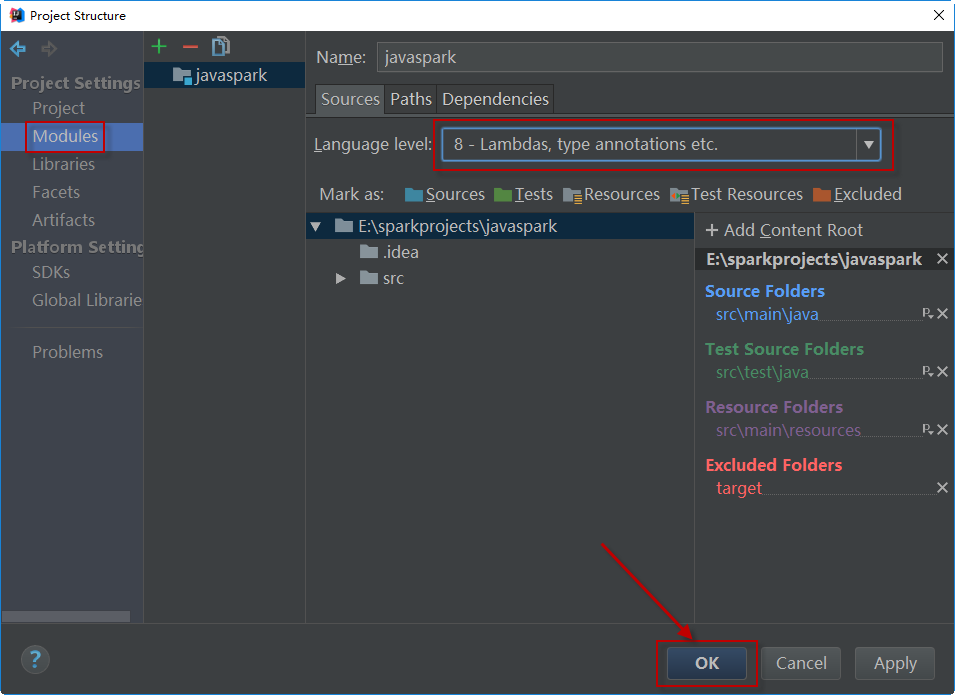

3)验证模块的Language level设置为Java版本:

【File】 > 【Project Structure...】 > 【Modules】,将右侧的的Language level值设置如下图:

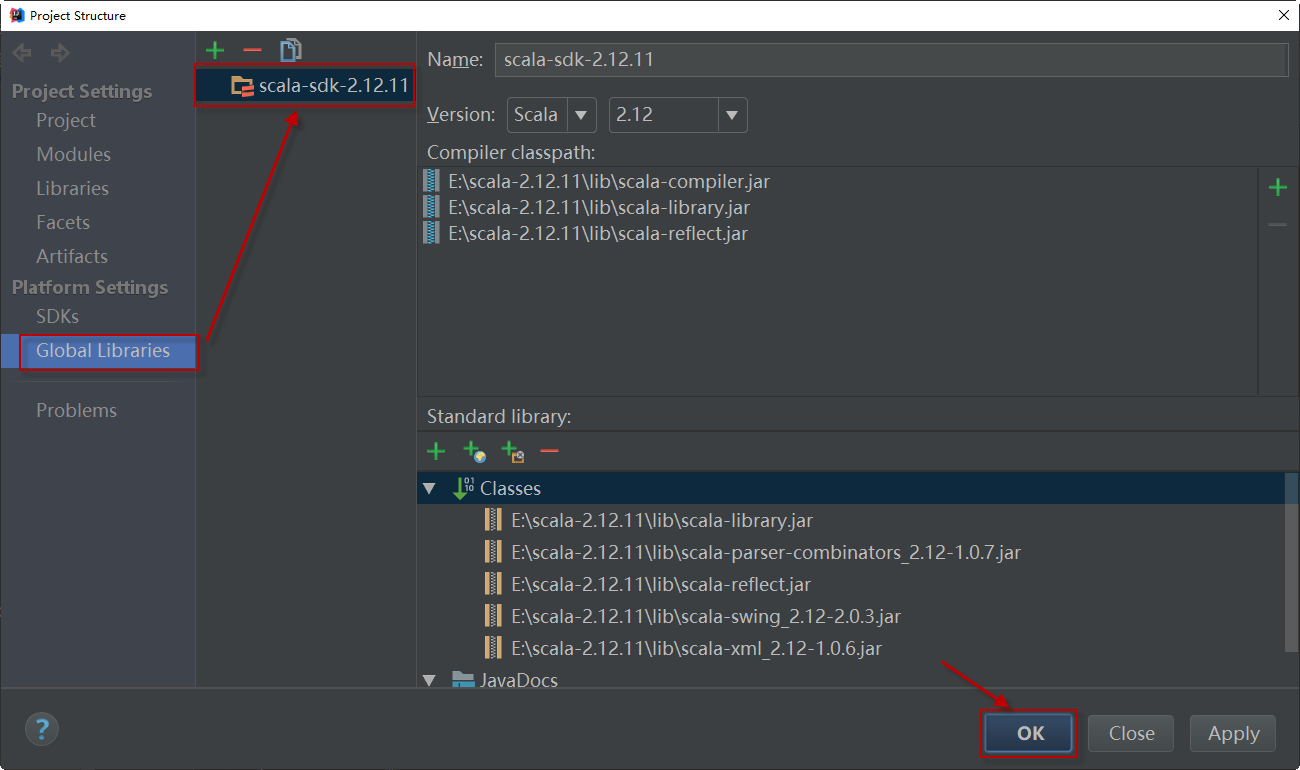

4)验证Global Libraries已经配置了Scala SDK

【File】 > 【Project Structure...】 > 【Global Libraries】,点击右侧的加号(+),浏览并选择本地安装的Scala SDK安装目录,设置如下图:

三、项目依赖和管理配置

在开始编写Spark应用程序之前,我们需要将Spark库和文档导入IntelliJ。要导入Spark库,我们将使用依赖管理器Maven。打开pom.xml配置文件,按以下步骤编辑。

1)首先,将Scala版本修改为最新的版本,我使用的是2.12.14:

<properties>

<scala.version>2.12.14</scala.version>

</properties>

2)删除如下部分:

<plugin>

<groupId>org.scala-tools</groupId>

<artifactId>maven-scala-plugin</artifactId>

<executions>

<execution>

<goals>

<goal>compile</goal>

<goal>testCompile</goal>

</goals>

</execution>

</executions>

<configuration>

<scalaVersion>${scala.version}</scalaVersion>

<args>

<arg>-target:jvm-1.8</arg>

</args>

</configuration>

</plugin>

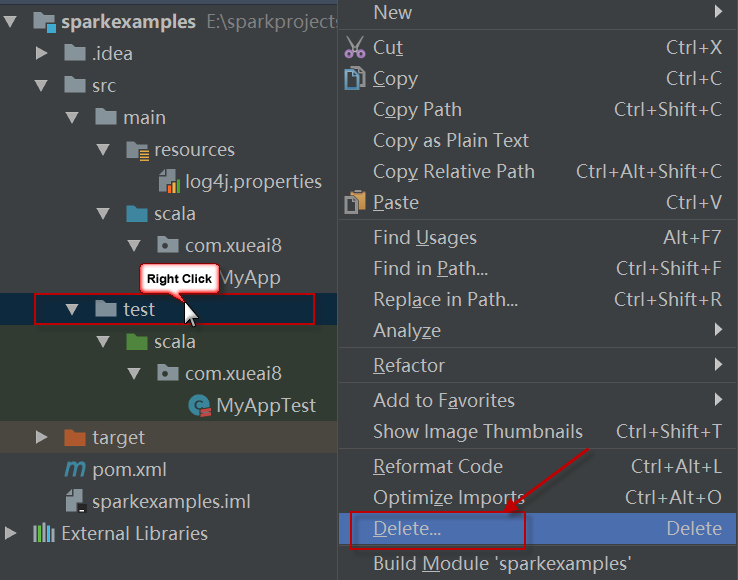

3)删除不必要的文件。

从项目结构中,删除如下部分:

- 删除src/test

- 删除src/main/scala/org.xueai8.App

4)添加Spark依赖到Maven pom.xml文件中。

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.12</artifactId>

<version>3.1.2</version>

<scope>compile</scope>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-sql_2.12</artifactId>

<version>3.1.2</version>

<scope>compile</scope>

</dependency>

5)最终的pom.xml文件如下所示:

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/maven-v4_0_0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>com.xueai8</groupId>

<artifactId>sparkexamples</artifactId>

<version>1.0-SNAPSHOT</version>

<properties>

<scala.version>2.12.11</scala.version>

</properties>

<dependencies>

<!--scala-->

<dependency>

<groupId>org.scala-lang</groupId>

<artifactId>scala-library</artifactId>

<version>${scala.version}</version>

</dependency>

<!--spark-->

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_2.12</artifactId>

<version>3.1.2</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-sql_2.12</artifactId>

<version>3.1.2</version>

</dependency>

</dependencies>

<build>

<sourceDirectory>src/main/scala</sourceDirectory>

<testSourceDirectory>src/test/scala</testSourceDirectory>

<plugins>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-compiler-plugin</artifactId>

<configuration>

<source>1.8</source>

<target>1.8</target>

</configuration>

</plugin>

</plugins>

</build>

</project>

保存文件后,IntelliJ将自动导入运行Spark所需的库和文档。这个过程有可能会持续较长时间。

四、测试程序

接下来,我们就可以开发基于Maven的Spark程序。

1)创建源程序

在src/main/scala上单击右键,创建一个Scala Object,命名为HelloWorld。编辑代码如下:

object HelloWorld {

def main(args: Array[String]): Unit = {

println("Hello World!")

}

}

有些时候,pom.xml中的依赖项不会自动加载,因此,需要重新导入依赖项或重启IntelliJ。

2)然后在文件任何空白地方,单击右键,在弹出的菜单中选择【Run 'MyApp'】,如果得到如下的输出结果,则一切OK!

Hello World!

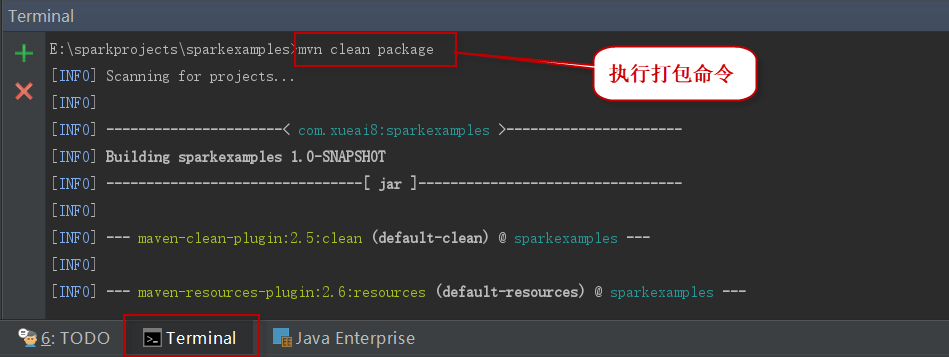

五、项目编译和打包

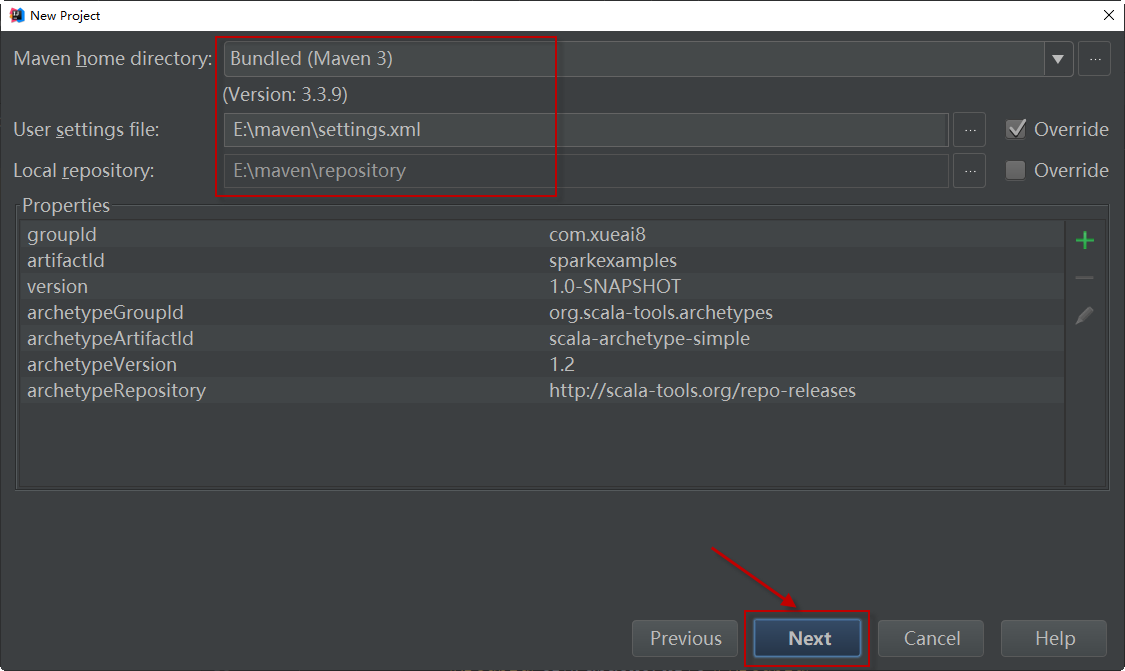

对于Maven项目,可以简单地在终端窗口运行如下的打包命令,就会自动编译并打jar包:

$ mvn clean package

如下图所示:

如果一切顺利,会在项目中生成target目录,打好的jar包就位于此目录下。如下图所示: