MapReduce案例-使用Hadoop计数器

什么是计数器?

计数器Counter是MapReduce用来记录Job执行过程中某些感兴趣的变量情况的,包括Job执行进度和状态,以及一些自定义变量。 计数器也可以理解为MapReduce提供的一种基于全局统计的日志,可以在程序的某个位置插入计数器,记录数据或者进度的变化情况。

Hadoop使用一系列计数器(counter)来聚合用于MapReduce计算的度量指标。 Hadoop计数器对于理解MapReduce程序的行为以及追踪MapReduce计算进度很有用。 我们可以自定义计数器来追踪MapReduce计算中特定应用程序的metrics。

计数器的功能主要分为两个方面:

- 1、性能调试

- 2、全局统计

这里我们演示了怎样定义一个自定义的计数器来统计我们的MapReduce程序中的字段缺失记录。

本例中我们使用枚举来定义自己的计数器。在一个枚举中的系列计数器将形成一组计数器。ApplicationMaster会聚合由Mapper和Reducer报告的计数器值。

问题描述

现有一个酒店数据的样本文件sample.csv,其内容如下所示。

sample.csv

SEQ,酒店,国家,省份,城市,商圈,星级,业务部门,房间数,图片数,评分,评论数 aba_2066,马尔康嘉绒大酒店,中国,四川,阿坝,,四星级/高档,OTA,85,,4.143799782,108 aba_2069,阿坝马尔康县澜峰大酒店,中国,四川,阿坝,,,低星,115,,3.977930069,129 aba_2094,阿坝鑫鸿大酒店,中国,四川,阿坝,四姑娘山,二星及其他,低星,,,, aba_2096,九寨沟管理局荷叶迎宾馆,中国,四川,阿坝,九寨沟沟口,二星及其他,低星,49,,3.972340107,394 aba_2097,九寨沟风景名胜区管理局贵宾楼饭店,中国,四川,阿坝,九寨沟沟口,三星级/舒适,低星,50,,4.12789011,585 aba_2098,九寨沟九鑫山庄,中国,四川,阿坝,九寨沟沟口,四星级/高档,OTA,60,,4.04046011,161 aba_2102,九寨沟冈拉美朵酒店,中国,四川,阿坝,九寨沟沟口,四星级/高档,OTA,198,,3.471659899,12 aba_2109,若尔盖大藏酒店古格王朝店,中国,四川,阿坝,西部旅游牧场,五星级/豪华,OTA,94,,3.263220072,62 aba_2111,若尔盖大藏酒店圣地店,中国,四川,阿坝,西部旅游牧场,四星级/高档,OTA,188,,3.921580076,119 aba_2117,九寨沟保利新九寨宾馆,中国,四川,阿坝,漳扎镇,五星级/豪华,OTA,329,,4.353809834,269 aba_2134,九寨沟名人酒店,中国,四川,阿坝,漳扎镇,三星级/舒适,低星,292,,4.539999962,57 aba_2150,九寨沟仁智度假酒店,中国,四川,阿坝,九寨沟沟口,三星级/舒适,低星,137,,3.782749891,173 aba_2152,九寨沟药泉山庄,中国,四川,阿坝,黄龙机场、川主寺,四星级/高档,OTA,128,,3.821099997,310 aba_2156,松潘黄龙寺华龙山庄,中国,四川,阿坝,黄龙风景区,四星级/高档,OTA,154,,3.315500021,107 aba_2213,阿坝山之旅背包客栈,中国,四川,阿坝,四姑娘山,二星及其他,客栈,20,,,13 aba_2217,阿坝若尔盖大酒店,中国,四川,阿坝,,二星及其他,低星,71,,4.267769814,2 aba_2233,九寨沟云天海大酒店,中国,四川,阿坝,九寨沟沟口,三星级/舒适,低星,100,,2.783930063, aba_2243,阿坝九旅假日酒店,中国,四川,阿坝,九寨沟沟口,四星级/高档,OTA,140,,3.00515008,49 aba_2248,九寨沟川主寺岷江源大酒店,中国,四川,阿坝,黄龙机场、川主寺,,低星,228,,3.211859941,109

我们需要先对数据进行清洗,然后进行统计。要求如下:

- 将采集错误的数据剔除;

- 将任意关键字段为空的条目剔除;关键字段定义为{星级、评分、评论数};

- 按酒店星级统计不同星级酒店的平均评分和总评论数;

- 分别统计星级字段、评分字段、评论数字段缺失值数量,并以打印语句输出。

一、创建Java Maven项目

Maven依赖:

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>HadoopDemo</groupId>

<artifactId>com.xueai8</artifactId>

<version>1.0-SNAPSHOT</version>

<dependencies>

<!--hadoop依赖-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>3.3.1</version>

</dependency>

<!--hdfs文件系统依赖-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>3.3.1</version>

</dependency>

<!--MapReduce相关的依赖-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-mapreduce-client-core</artifactId>

<version>3.3.1</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-mapreduce-client-jobclient</artifactId>

<version>3.3.1</version>

</dependency>

<!--junit依赖-->

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.12</version>

<scope>test</scope>

</dependency>

</dependencies>

<build>

<plugins>

<!--编译器插件用于编译拓扑-->

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<!--指定maven编译的jdk版本和字符集,如果不指定,maven3默认用jdk 1.5 maven2默认用jdk1.3-->

<artifactId>maven-compiler-plugin</artifactId>

<configuration>

<source>1.8</source> <!-- 源代码使用的JDK版本 -->

<target>1.8</target> <!-- 需要生成的目标class文件的编译版本 -->

<encoding>UTF-8</encoding><!-- 字符集编码 -->

</configuration>

</plugin>

</plugins>

</build>

</project>

枚举类HotelMapper.java:

自定义一个枚举类型,用于在MapReduce程序中标识各种不同的计数器。

package com.xueai8.counter;

/**

*

* 自定义枚举类型

*/

public enum MyCounter {

BAD_STAR_RECORDS,

BAD_SCORE_RECORDS,

BAD_COMMENT_RECORDS

}

HotelMapper.java:

Mapper类。在该类中,需要实现:

- 1、将任意关键字段为空的条目剔除。关键字段定义为{星级、评分、评论数};

- 2、按酒店星级统计不同星级酒店的平均评分和总评论数;

- 3、分别统计星级字段、评分字段、评论数字段缺失值数量,并以打印语句输出。

package com.xueai8.counter;

import org.apache.commons.lang3.StringUtils;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import org.slf4j.Logger;

import org.slf4j.LoggerFactory;

import java.io.IOException;

public class HotelMapper extends Mapper<LongWritable,Text,Text,Text> {

// 设置可重用的Text类型

private final static Text keyText = new Text();

private final static Text valueText = new Text();

// 每读入一行文本(一行酒店记录),就会调用下面这个函数进行处理(清洗转换)

// 向map传入的value参数,就是要处理的一行记录

@Override

protected void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

String line = value.toString(); // 先将Hadoop的Text类型转换为Java的String类型

String[] arr = line.split(",", -1); // 对一条记录进行拆分

// 过滤标题行

if("SEQ".equals(arr[0])){

return;

}

// 过滤字段不全的数据

if(arr.length < 12){

context.getCounter("MyCounter", "deleted_error").increment(1L);

return;

}

String star = arr[6]; // 星级字段

String score = arr[10]; // 评分字段

String comment = arr[11]; // 评论数字段

// 将字段{星级、评论数、评分}中任意字段为空的数据删除,

// 并记录到各自的计数器中

boolean flag = false;

if(StringUtils.isBlank(star)){

// 累加计数器

context.getCounter(MyCounter.BAD_STAR_RECORDS).increment(1);

flag = true;

}

if(StringUtils.isBlank(score)){

// 累加计数器

context.getCounter(MyCounter.BAD_SCORE_RECORDS).increment(1);

flag = true;

}

if(StringUtils.isBlank(comment) ){

// 累加计数器

context.getCounter(MyCounter.BAD_COMMENT_RECORDS).increment(1);

flag = true;

}

if(flag){

return;

}

// 将整理过后的数据写出

// 写出时,要从Java的String类型转换回Hadoop的Text类型

keyText.set(star); // key

valueText.set(score + "," + comment); // value

context.write(keyText, valueText);

}

}

HotelReducer.java:

Reducer类。在该类中按酒店星级统计不同星级酒店的平均评分和总评论数。

package com.xueai8.counter;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

import java.io.IOException;

public class HotelReducer extends Reducer<Text, Text, Text, Text>{

private static Text outKey = new Text(); // out key

private static Text outValue = new Text(); // out value

@Override

protected void reduce(Text key, Iterable<Text> values, Context context)

throws IOException, InterruptedException {

// 计算平均评分和总评论数

int count = 0;

double totalScore = 0.0;

int totalComment = 0;

for(Text item : values){

String[] data = item.toString().split(",");

totalScore += Double.parseDouble(data[0]);

totalComment += Integer.parseInt(data[1]);

count++;

}

double avgScore = totalScore/count; // 平均评分

// 写出

outKey.set(key);

outValue.set(avgScore + "," + totalComment);

context.write(outKey, outValue);

}

}

HotelDriver.java:

驱动程序。

package com.xueai8.counter;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Counter;

import org.apache.hadoop.mapreduce.Counters;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.input.TextInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.mapreduce.lib.output.TextOutputFormat;

import java.io.IOException;

public class HotelDriver {

public static void main(String[] args) throws IOException, ClassNotFoundException, InterruptedException {

if (args.length < 2) {

System.err.println("语法: HotelDriver <in> <out>");

System.exit(-1); // 非正常退出

}

// 指定hdfs相关的参数

Configuration conf = new Configuration();

Job job = Job.getInstance(conf,"counter demo");

// 设置jar包所在路径

job.setJarByClass(HotelDriver.class);

// 设置Mapper类

job.setMapperClass(HotelMapper.class);

job.setReducerClass(HotelReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(Text.class);

FileInputFormat.setInputPaths(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

// 最后提交任务

boolean waitForCompletion = job.waitForCompletion(true);

// 访问计数器

Counters counters = job.getCounters();

Counter counterStar = counters.findCounter(MyCounter.BAD_STAR_RECORDS);

System.out.println("====星级字段缺失的记录数:" + counterStar.getValue() + "====");

Counter counterScore = counters.findCounter(MyCounter.BAD_SCORE_RECORDS);

System.out.println("====评分字段缺失的记录数:" + counterStar.getValue() + "====");

Counter counterComment = counters.findCounter(MyCounter.BAD_COMMENT_RECORDS);

System.out.println("====评论数字段缺失的记录数:" + counterStar.getValue() + "====");

System.exit(waitForCompletion ? 0 : 1);

}

}

二、配置log4j

在src/main/resources目录下新增log4j的配置文件log4j.properties,内容如下:

log4j.rootLogger = info,stdout

### 输出信息到控制抬 ###

log4j.appender.stdout = org.apache.log4j.ConsoleAppender

log4j.appender.stdout.Target = System.out

log4j.appender.stdout.layout = org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern = [%-5p] %d{yyyy-MM-dd HH:mm:ss,SSS} method:%l%n%m%n

三、项目打包

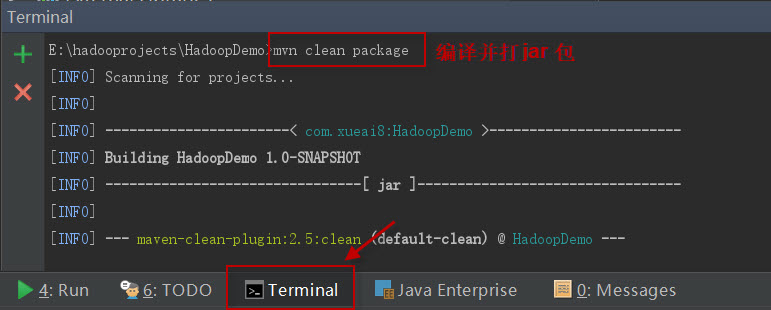

打开IDEA下方的终端窗口terminal,执行"mvn clean package"打包命令,如下图所示:

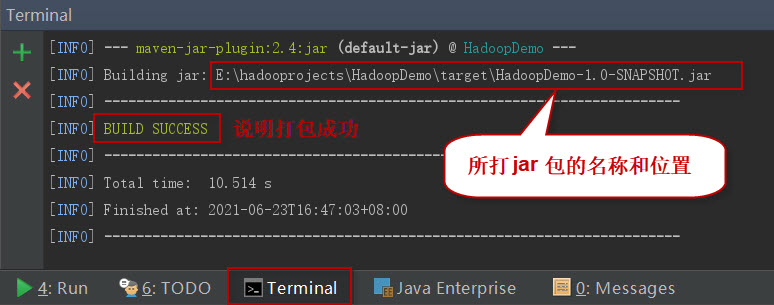

如果一切正常,会提示打jar包成功。如下图所示:

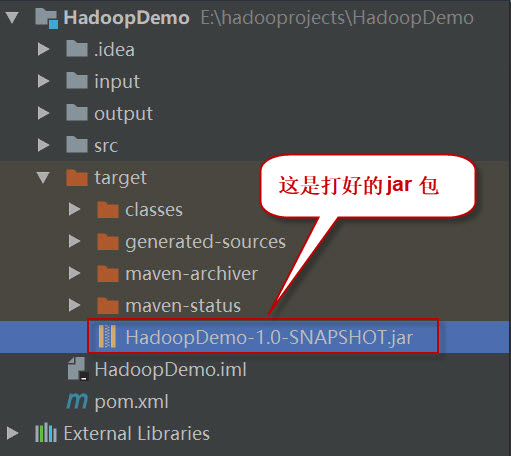

这时查看项目结构,会看到多了一个target目录,打好的jar包就位于此目录下。如下图所示:

四、项目部署

请按以下步骤执行。

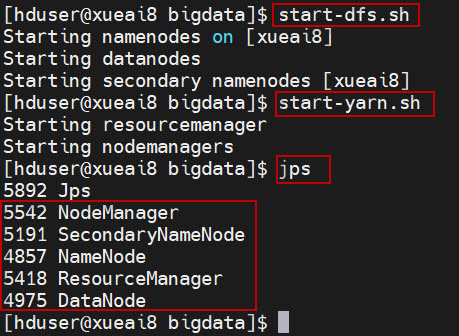

1、启动HDFS集群和YARN集群。在Linux终端窗口中,执行如下的脚本:

$ start-dfs.sh

$ start-yarn.sh

查看进程是否启动,集群运行是否正常。在Linux终端窗口中,执行如下的命令:

$ jps

这时应该能看到有如下5个进程正在运行,说明集群运行正常:

5542 NodeManager

5191 SecondaryNameNode

4857 NameNode

5418 ResourceManager

4975 DataNode

2、将数据文件sample.txt上传到HDFS的/data/mr/目录下。

$ hdfs dfs -mkdir -p /data/mr $ hdfs dfs -put sample.txt /data/mr/ $ hdfs dfs -ls /data/mr/

3、提交作业到Hadoop集群上运行。(如果jar包在Windows下,请先拷贝到Linux中。)

在终端窗口中,执行如下的作业提交命令:

$ hadoop jar com.xueai8-1.0-SNAPSHOT.jar com.xueai8.counter.HotelDriver /data/mr /data/mr-output

注意观察控制台中输出的信息,应该可以看到如下内容。请注意其中的计数器部分:

Counters: 33 File System Counters FILE: Number of bytes read=15216 FILE: Number of bytes written=1821117 FILE: Number of read operations=0 FILE: Number of large read operations=0 FILE: Number of write operations=0 Map-Reduce Framework Map input records=40 Map output records=33 Map output bytes=1058 Map output materialized bytes=1136 Input split bytes=243 Combine input records=0 Combine output records=0 Reduce input groups=4 Reduce shuffle bytes=1136 Reduce input records=33 Reduce output records=4 Spilled Records=66 Shuffled Maps =2 Failed Shuffles=0 Merged Map outputs=2 GC time elapsed (ms)=0 Total committed heap usage (bytes)=970457088 Shuffle Errors BAD_ID=0 CONNECTION=0 IO_ERROR=0 WRONG_LENGTH=0 WRONG_MAP=0 WRONG_REDUCE=0 com.xueai8.counter.MyCounter BAD_COMMENT_RECORDS=2 BAD_SCORE_RECORDS=2 BAD_STAR_RECORDS=2 File Input Format Counters Bytes Read=4556 File Output Format Counters Bytes Written=173 ====星级字段缺失的记录数:2==== ====评分字段缺失的记录数:2==== ====评论数字段缺失的记录数:2==== Process finished with exit code 0

4、查看输出结果。

在终端窗口中,执行如下的HDFS命令,查看输出结果:

$ hdfs dfs -ls /data/mr-output

可以看到如下的输出结果:

三星级/舒适 3.955029998428571,1637 二星及其他 3.7323937417500006,1044 五星级/豪华 3.8085149529999995,662 四星级/高档 3.6741785664285715,1732