一个MapReduce计算写入多个输出

有时,我们要求Hadoop作业将数据写入多个输出位置。Hadoop提供了一种工具,可以根据我们的需要,使用MultipleOutputs类在不同的位置编写作业的输出。

Hadoop的MultipleOutputs类提供了将Hadoop map/reducer输出写到多个文件夹的工具。这个MultipleOutputs特性也允许我们为每个输出指定一个不同的OutputFormat。

MultipleOutputs类有一个静态方法addNamedOutput,用于向给定的作业添加指定的输出。该方法的签名如下:

public static void addNamedOutput(Job job,

String namedOutput,

Class<? extends OutputFormat> outputFormatClass,

Class<?> keyClass,

Class<?> valueClass)

下面是使用该方法的代码片段:

MultipleOutputs.addNamedOutput(job,"AHMEDABAD", TextOutputFormat.class,Text.class,Text.class); MultipleOutputs.addNamedOutput(job,"DELHI", TextOutputFormat.class,Text.class,Text.class); MultipleOutputs.addNamedOutput(job,"MUMBAI", TextOutputFormat.class,Text.class,Text.class);

MultipleOutputs类的write方法用于将输出写入不同的文件。这种方法有多种形式。我们将例如如下这种方法形式:

public <K, V> void write(String namedOutput, K key, V value, String baseOutputPath)

只需要在MapClass或Reduce类中加入如下代码:

private MultipleOutputs<Text, IntWritable> mos;

public void setup(Context context) throws IOException,InterruptedException {

mos = new MultipleOutputs(context);

}

public void cleanup(Context context) throws IOException,InterruptedException {

mos.close();

}

然后就可以用mos.write(Key key,Value value,String baseOutputPath)代替context.write(key, value)。

问题描述

在这个例子中,我们将使用Hadoop MultipleOutputs特性在不同的HDFS文件夹中编写城市员工记录。

一、创建Java Maven项目

Maven依赖:

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>HadoopDemo</groupId>

<artifactId>com.xueai8</artifactId>

<version>1.0-SNAPSHOT</version>

<dependencies>

<!--hadoop依赖-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-common</artifactId>

<version>3.3.1</version>

</dependency>

<!--hdfs文件系统依赖-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-hdfs</artifactId>

<version>3.3.1</version>

</dependency>

<!--MapReduce相关的依赖-->

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-mapreduce-client-core</artifactId>

<version>3.3.1</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-mapreduce-client-jobclient</artifactId>

<version>3.3.1</version>

</dependency>

<!--junit依赖-->

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.12</version>

<scope>test</scope>

</dependency>

</dependencies>

<build>

<plugins>

<!--编译器插件用于编译拓扑-->

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<!--指定maven编译的jdk版本和字符集,如果不指定,maven3默认用jdk 1.5 maven2默认用jdk1.3-->

<artifactId>maven-compiler-plugin</artifactId>

<configuration>

<source>1.8</source> <!-- 源代码使用的JDK版本 -->

<target>1.8</target> <!-- 需要生成的目标class文件的编译版本 -->

<encoding>UTF-8</encoding><!-- 字符集编码 -->

</configuration>

</plugin>

</plugins>

</build>

</project>

MultipleOutputsMapper.java:

Mapper类。

package com.xueai8.multioutput;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import org.apache.hadoop.mapreduce.lib.output.MultipleOutputs;

import java.io.IOException;

// 引入静态常量

import static com.xueai8.multioutput.MultipleOutputsDriver.*;

public class MultipleOutputsMapper extends Mapper<Text,Text,Text,Text> {

private MultipleOutputs<Text, Text> multipleOutputs;

@Override

protected void setup(Context context) throws IOException, InterruptedException {

multipleOutputs = new MultipleOutputs<>(context);

}

@Override

protected void map(Text key, Text value, Context context) throws IOException, InterruptedException {

String empData[] = value.toString().split(",");

// 多路输出:根据员工姓名

if(empData[3].equalsIgnoreCase(AHMEDABAD)){

multipleOutputs.write(AHMEDABAD, key, value, "AHMEDABAD/AHMEDABAD");

}else if (empData[3].equalsIgnoreCase(DELHI)){

multipleOutputs.write(DELHI, key, value, "DELHI/DELHI");

}else if(empData[3].equalsIgnoreCase(MUMBAI)){

multipleOutputs.write(MUMBAI, key, value, "MUMBAI/MUMBAI");

}else {

multipleOutputs.write(OTHER, key, value, "OTHER/OTHER");

}

}

@Override

protected void cleanup(Context context) throws IOException, InterruptedException {

multipleOutputs.close();

}

}

本示例没有Reducer类。

MultipleOutputsDriver.java:

驱动程序类。注意这里我们使用了ToolRunner接口。

package com.xueai8.multioutput;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.conf.Configured;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.input.KeyValueTextInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import org.apache.hadoop.mapreduce.lib.output.MultipleOutputs;

import org.apache.hadoop.mapreduce.lib.output.TextOutputFormat;

import org.apache.hadoop.util.GenericOptionsParser;

import org.apache.hadoop.util.Tool;

import org.apache.hadoop.util.ToolRunner;

public class MultipleOutputsDriver extends Configured implements Tool {

public static final String OTHER = "OTHER";

public static final String MUMBAI = "MUMBAI";

public static final String DELHI = "DELHI";

public static final String AHMEDABAD = "AHMEDABAD";

public static void main(String[] args) throws Exception {

int exitCode = ToolRunner.run(new Configuration(), new MultipleOutputsDriver(), args);

System.exit(exitCode);

}

public int run(String[] args) throws Exception {

if (args.length != 2) {

System.out.println("执行此程序需要两个参数:");

System.out.println("[ 1 ] 输入路径");

System.out.println("[ 2 ] 输出路径");

return -1;

}

String[] otherArgs = new GenericOptionsParser(getConf(),args).getRemainingArgs();

Path input=new Path(otherArgs[0]);

Path output=new Path(otherArgs[1]);

Job job = Job.getInstance(getConf(),"multi output");

job.setJarByClass(MultipleOutputsDriver.class);

// set mapper

job.setMapperClass(MultipleOutputsMapper.class);

job.setMapOutputKeyClass(Text.class);

job.setMapOutputValueClass(Text.class);

// set reducer

job.setNumReduceTasks(0);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(Text.class);

// set input & output format

job.setInputFormatClass(KeyValueTextInputFormat.class);

job.setOutputFormatClass(TextOutputFormat.class);

FileInputFormat.addInputPath(job, input);

FileOutputFormat.setOutputPath(job, output);

/*** 添加多路输出的命名 ***/

MultipleOutputs.addNamedOutput(job,AHMEDABAD , TextOutputFormat.class,Text.class,Text.class);

MultipleOutputs.addNamedOutput(job,DELHI, TextOutputFormat.class,Text.class,Text.class);

MultipleOutputs.addNamedOutput(job,MUMBAI, TextOutputFormat.class,Text.class,Text.class);

MultipleOutputs.addNamedOutput(job,OTHER, TextOutputFormat.class,Text.class,Text.class);

boolean success = job.waitForCompletion(true);

return (success ? 0 : 1);

}

}

二、配置log4j

在src/main/resources目录下新增log4j的配置文件log4j.properties,内容如下:

log4j.rootLogger = info,stdout

### 输出信息到控制抬 ###

log4j.appender.stdout = org.apache.log4j.ConsoleAppender

log4j.appender.stdout.Target = System.out

log4j.appender.stdout.layout = org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern = [%-5p] %d{yyyy-MM-dd HH:mm:ss,SSS} method:%l%n%m%n

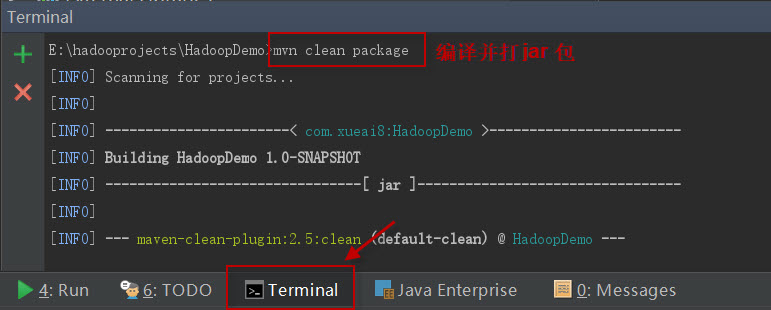

三、项目打包

打开IDEA下方的终端窗口terminal,执行"mvn clean package"打包命令,如下图所示:

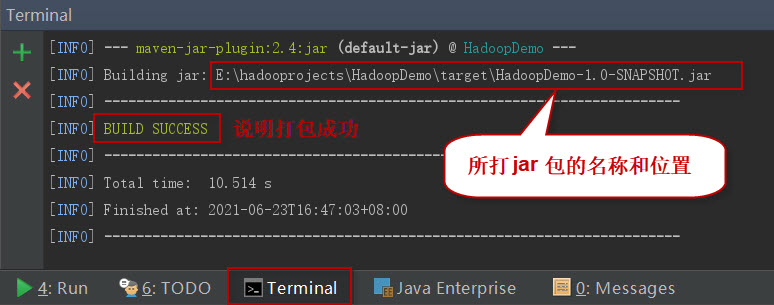

如果一切正常,会提示打jar包成功。如下图所示:

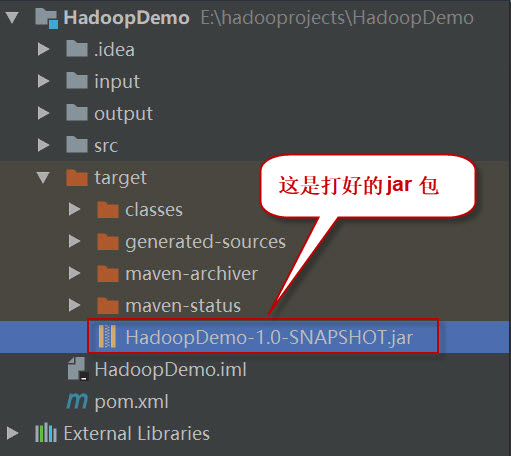

这时查看项目结构,会看到多了一个target目录,打好的jar包就位于此目录下。如下图所示:

四、项目部署

请按以下步骤执行。

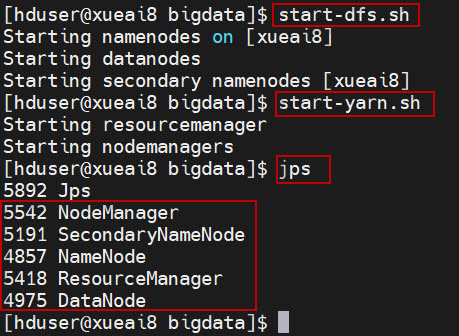

1、启动HDFS集群和YARN集群。在Linux终端窗口中,执行如下的脚本:

$ start-dfs.sh $ start-yarn.sh

查看进程是否启动,集群运行是否正常。在Linux终端窗口中,执行如下的命令:

$ jps

这时应该能看到有如下5个进程正在运行,说明集群运行正常:

5542 NodeManager

5191 SecondaryNameNode

4857 NameNode

5418 ResourceManager

4975 DataNode

2、先在本地创建一个输入数据文件employees.txt,并编辑内容如下:

1 John Cena,Sr.Software Engineer,TCS,Ahmedabad 2 Peter,Sr.Software Engineer,Infosys,Delhi 3 S. Mathur,Software Engineer,capgemini,Mumbai 4 Ranvir D.,Data scientiest,TCS,Ahmedabad 5 Kane Will,Technical Lead,TCS,Ahmedabad

3、将数据文件employees.txt上传到HDFS的/data/mr/目录下。

$ hdfs dfs -mkdir -p /data/mr $ hdfs dfs -put employees.txt /data/mr/ $ hdfs dfs -ls /data/mr/

4、提交作业到Hadoop集群上运行。(如果jar包在Windows下,请先拷贝到Linux中。)

在终端窗口中,执行如下的作业提交命令:

$ hadoop jar HadoopDemo-1.0-SNAPSHOT.jar com.xueai8.multioutput.MultipleOutputsDriver /data/mr /data/mr-output

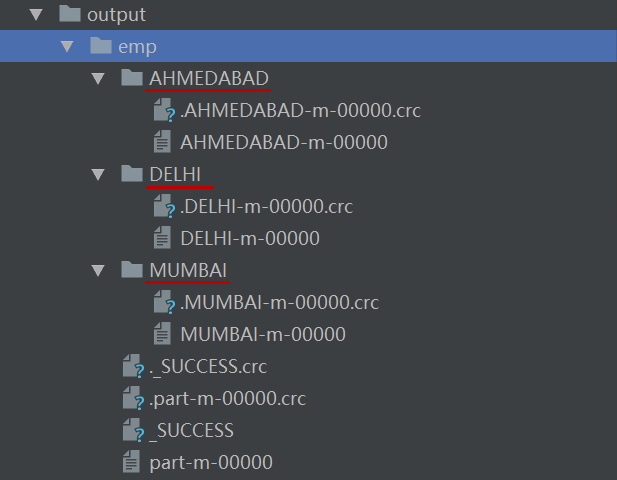

5、查看输出结果。

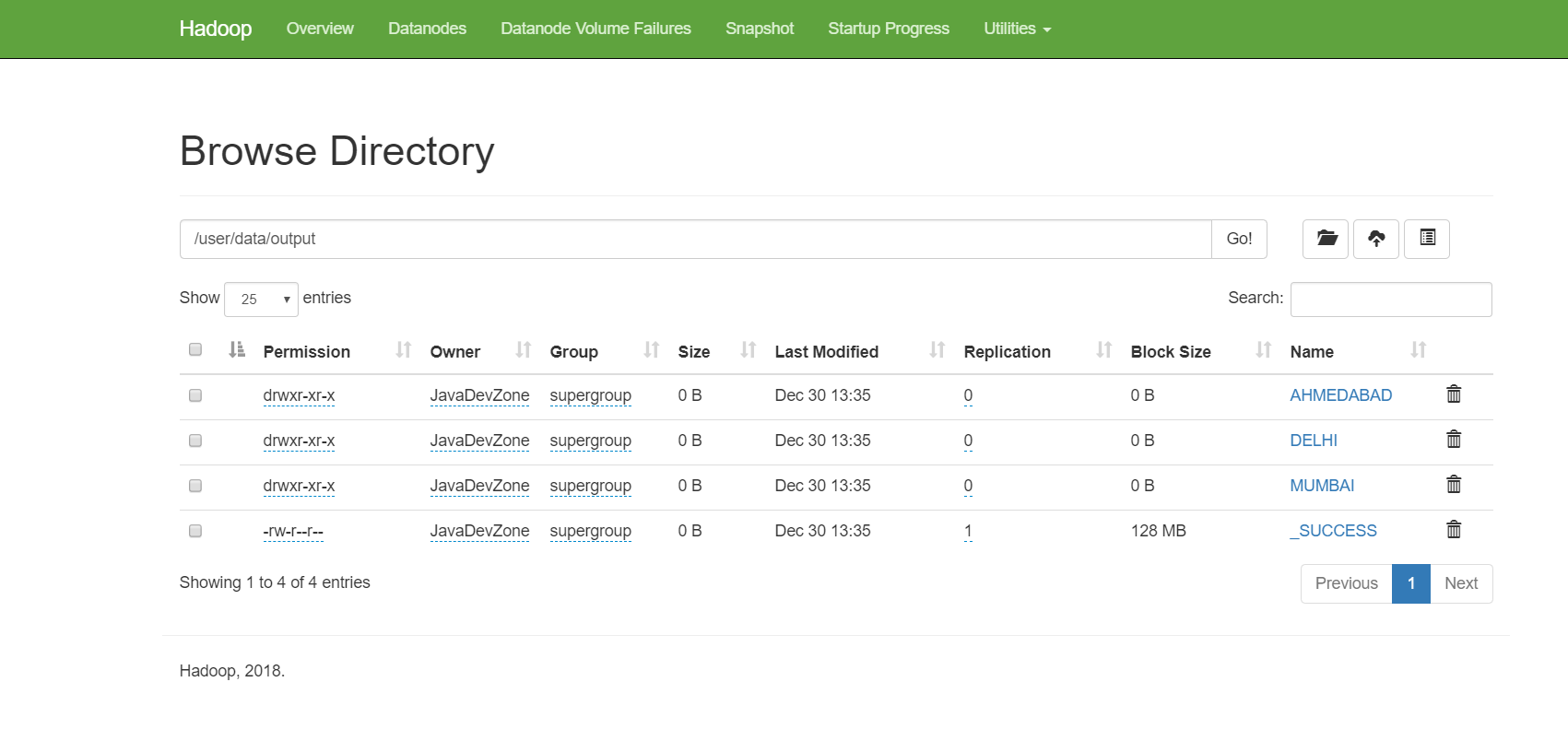

查看输出目录,可以看到每个命名输出写到一个单独的文件夹中了。如下图所示:

也可以通过浏览器查看HDFS上生成的目录: