2022(7.20更新)高职大数据竞赛(任务书一)-数据采集与实时计算任务一:实时数据采集

编写Scala工程代码,使用Flink消费Kafka中Topic为order的数据并进行相应的数据统计计算。

子任务

子任务说明

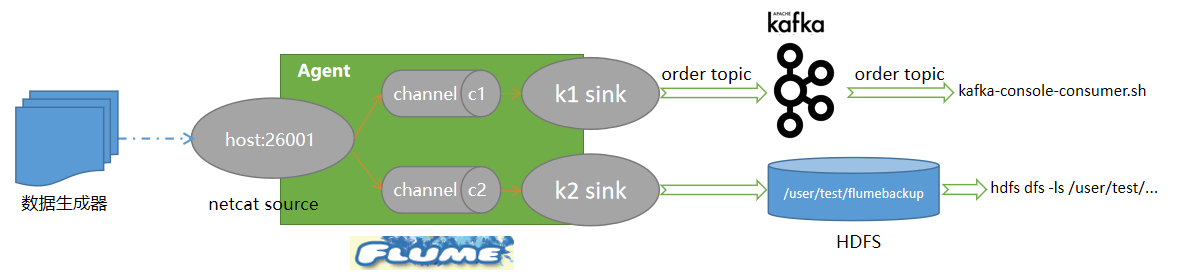

1、在Master节点使用Flume采集实时数据生成器10050端口的socket数据,将数据存入到Kafka的Topic中(Topic名称为order,分区数为4),使用Kafka自带的消费者消费order(Topic)中的数据,将前2条数据的结果截图粘贴至对应报告中;

2、采用多路复用模式,Flume接收数据注入kafka 的同时,将数据备份到HDFS目录/user/test/flumebackup下,将查看备份目录下的第一个文件的前2条数据的命令与结果截图粘贴至对应报告中。

实现原理

技术参考1:安装Apache Flume。

技术参考2:Flume集成Kafka。

测试环境:本案例演示使用小白学苑开发的PBCP(个人大数据竞赛平台)。

Flume配置

在$FLUME_HOME/conf/目录下,创建一个flume配置文件gs20220720.conf,编辑内容如下:

a1. ......

......

抱歉,只有登录会员才可浏览!会员登录